Machine Vision 101: Wie die automatisierte optische Inspektion tatsächlich funktioniert

In unserem letzten Blogbeitrag haben wir erörtert, warum die herkömmliche Stichprobenprüfung ein Risiko darstellt. Diese Woche lüften wir den Vorhang für die Technologie, die dieses Problem löst: Automatisierte Optische Inspektion (AOI).

Für viele in der Fertigung können AOI-Systeme wie mysteriöse Blackboxes erscheinen. Wie kann eine Maschine eine komplexe Komponente möglicherweise mit mehr Genauigkeit und Geschwindigkeit sehen und beurteilen als ein geschulter Mensch? Die Antwort liegt in einem ausgeklügelten und doch elegant logischen Prozess, der das menschliche Sehen nachahmt – und bei weitem übertrifft.

Im Kern ist ein AOI-System ein Roboterauge mit einem Gehirn. Lassen Sie uns aufschlüsseln, wie es funktioniert, vom Licht bis zur Erkenntnis.

Die vier Säulen des maschinellen Sehens: Die Hardware

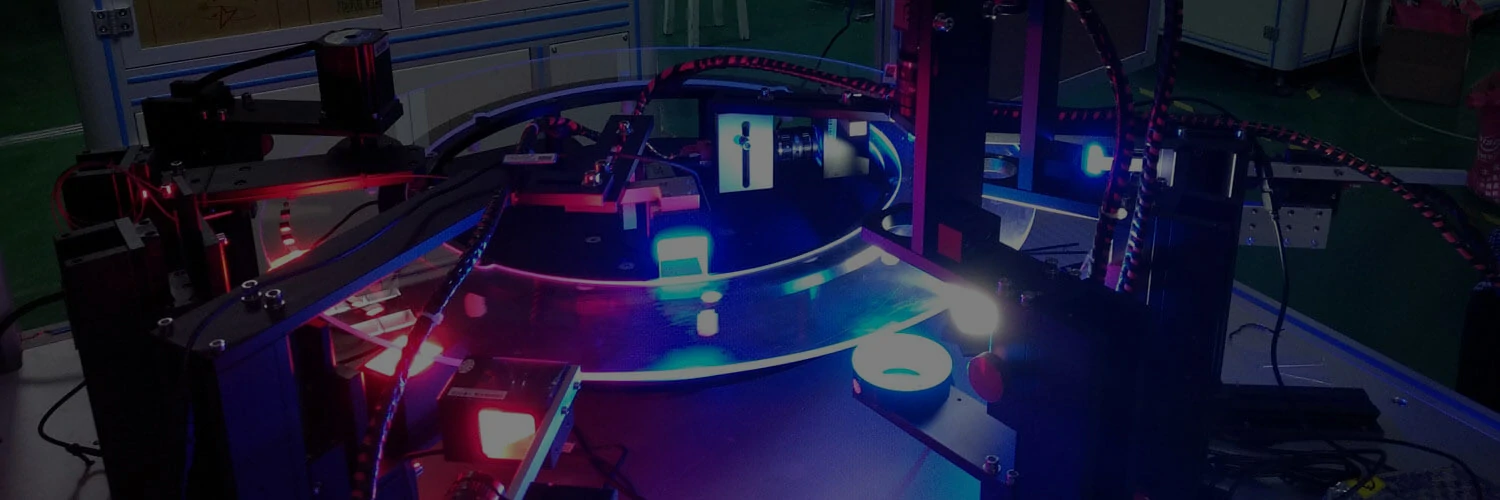

Jedes AOI-System, von einem einfachen Anwesenheitsdetektor bis zu den fortschrittlichsten KI-gestützten Sortierern von Openex, basiert auf vier wesentlichen Hardwarekomponenten:

-

1. Beleuchtung: Die Grundlage des Sehens Dies ist das kritischste Element. Die richtige Beleuchtung stellt sicher, dass die Kamera das interessierende Merkmal konsistent sehen kann. Wir verwenden spezielle Leuchten (LED-Ringe, Dome-Leuchten, Hintergrundbeleuchtungen), um Konturen, Oberflächentexturen oder Kanten hervorzuheben und Fehler wie Kratzer, Dellen oder Hohlräume in starkem Kontrast hervorzuheben.

-

2. Objektiv & Kamera: Das Auge Das Objektiv fokussiert Licht auf einen digitalen Sensor in der Kamera. Hochauflösende Sensoren erfassen unglaublich detaillierte Bilder, während Hochgeschwindigkeitskameras Tausende von scharfen Bildern pro Minute aufnehmen können, selbst auf sich schnell bewegenden Produktionslinien. Dies ist die „Netzhaut“ des Systems.

-

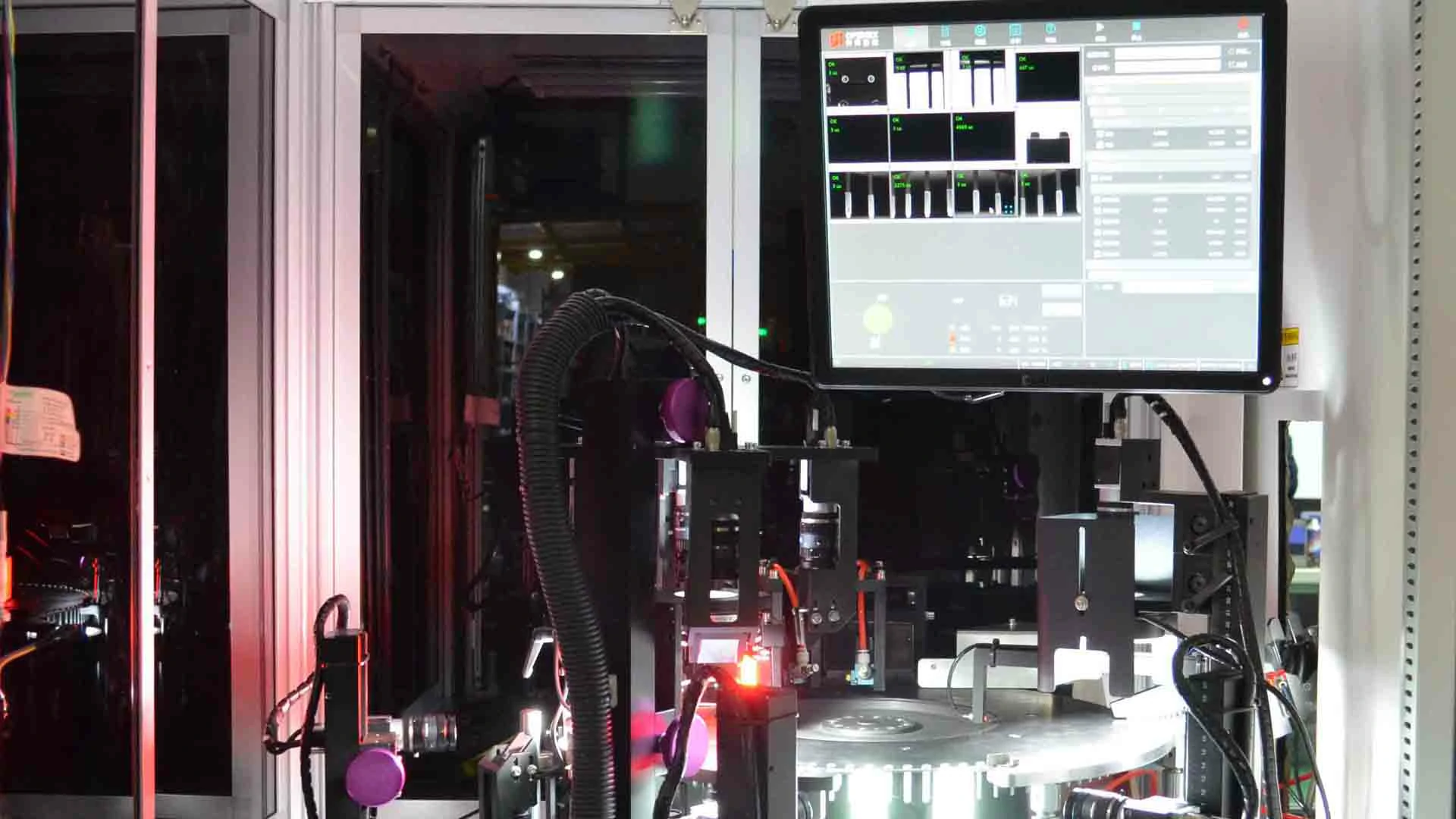

3. Verarbeitungseinheit: Das Gehirn Dies ist ein leistungsstarker Industriecomputer (IPC) oder ein dedizierter Vision-Controller. Er empfängt nicht nur das Bild, er verarbeitet es auch. Hier analysieren die Softwarealgorithmen das Bild, um in Millisekunden eine Gut/Schlecht-Entscheidung zu treffen. Dies ist das „Gehirn“ des Systems.

-

4. Kommunikation & Betätigung: Das Nervensystem Sobald eine Entscheidung getroffen ist, muss das System handeln. Es sendet ein Signal über E/A-Kabel (Input/Output) oder ein Netzwerk an nachgeschaltete Maschinen – wie einen Roboterarm, um ein defektes Teil aufzunehmen, einen Auswerferarm, um es von der Linie zu stoßen, oder einen Drucker, um es zu markieren.

Der Software-Workflow: Vom Bild zur Aktion

Die Hardware erfasst die Daten, aber die Software findet die Bedeutung. Der Inspektionsprozess folgt diesen Schritten:

- 1. Bilderfassung: Die Kamera, ausgelöst durch einen Sensor, erfasst ein hochwertiges Bild unter perfekt kontrollierter Beleuchtung.

- 2. Vorverarbeitung: Die Software verbessert das Bild, um die Analyse zu erleichtern. Dies kann das Anpassen des Kontrasts, das Reduzieren von Rauschen oder das Schärfen von Kanten umfassen.

- 3. Analyse & Algorithmusausführung: Hier geschieht die Magie. Die Software verwendet leistungsstarke Werkzeuge, um das Teil zu inspizieren:

- Traditionelle regelbasierte Algorithmen: Suchen nach vordefinierten Mustern. Zum Beispiel „Kanten finden und den Abstand zwischen ihnen messen“, um Abmessungen zu überprüfen, oder „nach einem Pixelhaufen suchen, der dunkler ist als die Umgebung“, um einen Fleck zu finden.

- KI & Deep Learning: Für komplexe, subjektive oder unvorhersehbare Fehler (z. B. subtile Materialverfärbungen, komplexe texturierte Oberflächen) können KI-Modelle, die auf Tausenden von Bildern trainiert wurden, differenzierte Urteile fällen, ähnlich wie ein menschlicher Experte, aber mit unerschütterlicher Konsistenz.

- 4. Entscheidung & Kommunikation: Die Software vergleicht die Analyseergebnisse mit den von Ihnen festgelegten Akzeptanzkriterien. Liegt die Messung innerhalb der Toleranz? Ist ein Fehler vorhanden? Basierend darauf sendet sie ein Signal: OK oder NG (Nicht gut).

- 5. Betätigung: Der Auswerfermechanismus (z. B. ein Luftstrahl, ein Schieberarm) entfernt das defekte Teil physisch von der Produktionslinie basierend auf dem Signal.

Warum maschinelles Sehen das menschliche Sehen jedes Mal übertrifft

- Geschwindigkeit: Inspiziert Tausende von Teilen pro Stunde, weit über die menschlichen Fähigkeiten hinaus.

- Genauigkeit & Konsistenz: Wird nie müde, gelangweilt oder abgelenkt. Es wendet den exakt gleichen Standard auf jedes einzelne Teil an, rund um die Uhr.

- Präzision: Misst Merkmale mit mikroskopischen Toleranzen, die für das menschliche Auge unsichtbar sind.

- Datenreichtum: Es lehnt nicht nur ein Teil ab; es zeichnet den Fehlertyp, den Ort und den Zeitstempel für jedes einzelne Ereignis auf und erstellt so einen leistungsstarken Datensatz für die Qualitätsrückverfolgbarkeit und Prozessverbesserung.

Bereit, die Sprache des maschinellen Sehens zu sprechen?

Die Welt der AOI hat ihre eigene Terminologie. Das Verständnis von Begriffen wie „Pixel“, „ROI“, „Fehlalarm“ und „telezentrisches Objektiv“ ist der Schlüssel zur Spezifizierung und zum Verständnis Ihres Inspektionssystems.

Wir haben ein Glossar zur visuellen Inspektion erstellt, um den Fachjargon zu entmystifizieren. Es ist eine unverzichtbare Ressource für Ingenieure, Qualitätsmanager und alle, die eine automatisierte Inspektion bewerten oder implementieren möchten.

In diesem kostenlosen Glossar finden Sie klare Definitionen von:

- Wichtigen Hardwarekomponenten (Sensoren, Optik, IPC)

- Wesentlichen Softwarebegriffen (Algorithmen, Deep Learning, OCR)

- Kritischen Leistungsmetriken (Genauigkeit, Wiederholbarkeit, FPS)

- Und vielem mehr.

[Besuchen Sie hier das Glossar zur visuellen Inspektion]

Stärken Sie Ihr Team mit Wissen. Laden Sie das Glossar noch heute herunter und beginnen Sie, die Sprache der Qualitätsautomatisierung zu sprechen.